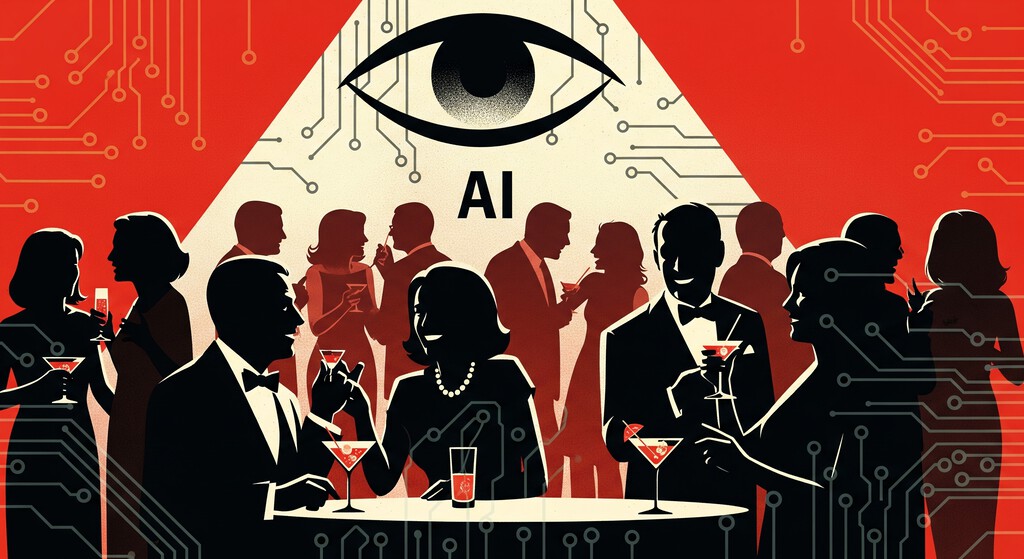

Un grupo de expertos en IA asistieron a una fiesta en una mansión. El tema de conversación: qué habrá cuando la IA acabe con la humanidad

Publicado el 22/06/2025 por Diario Tecnología Artículo original

En una mansión con vistas al Golden Gate, la élite de la inteligencia artificial se reunió el pasado domingo para debatir una cuestión inquietante: el fin de la humanidad y lo que vendrá después. Entre copas (sin alcohol) sus alrededor de 100 asistentes, entre los que había filósofos, empresarios e investigadores, imaginaron un futuro en el que los humanos ya no existimos, pero sí una inteligencia creada por nosotros. ¿Cómo debería ser nuestra sucesora?

La fiesta del fin del mundo. El evento que hemos conocido a través de este reportaje de Wired fue llamado ‘Worthy Successor’ y tenía como objetivo discutir precisamente sobre eso: definir un “sucesor a la altura” para cuando la humanidad ya no exista. Esta idea está relacionada con la creación de una inteligencia artificial general o AGI, por sus siglas en inglés. Un (de momento) concepto de superinteligencia que superaría al ser humano en todas las facetas del conocimiento, tan buena que, en palabras de Daniel Faggella, anfitrión de la fiesta: “Preferirías con mucho gusto que ella (no la humanidad) determine el camino futuro de la vida misma”.

Quienes asistieron. Lo primero: ¿quién es este tipo y por qué deberíamos escucharlo? Faggella es el fundador de Emerj Artificial Intelligence Research, una firma de consultoría y análisis de IA. En 2016 escribía en TechCrunch sobre los riesgos de la IA y actualmente está centrado en divulgar sobre IA desde un enfoque moral y filosófico, concretamente el de la creación de este ‘worthy succesor’ una idea que llevaba rondando desde hace tiempo. Según cuenta en LinkedIN, ha ido contactando con distintas personalidades relevantes de la industria para, dos años después, conseguir celebrar esta reunión.

En la fiesta se pudieron escuchar tres ponencias de la mano de Ginevra Davis, escritora neoyorkina, el filósofo Michael Edward Johnson y el propio anfitrión. La lista completa de invitados no ha trascendido, pero Faggella presume de que asistieron fundadores de empresas de IA con valores de hasta 5.000 millones de dólares, gente de los laboratorios que están investigando para crear una AGI y algunos de los filósofos y pensadores más importantes del sector.

La superinteligencia que acabará con todo. En palabras de Faggella a Wired: “los grandes laboratorios saben que la AGI probablemente acabará con la humanidad, pero no hablan de ello porque los incentivos no lo permiten”. Suena a teoría de la conspiración, pero no es el primero que advierte de algo así. Hace una década, Bill Gates nos decía que deberíamos temer a la IA. Poco después Musk exigía una regulación para mitigar los peligros de lo que estaba por venir. Más recientemente, distintos expertos en IA firmaban un mensaje que alertaba del “riesgo de extinción por IA”. OpenAI también pensaba en los riesgos de la AGI. Incluso se habla de que sus declaraciones sobre la creación de una AGI habría sido el motivo del sonado despido de Altman meses después.

Qué hay de cierto en todo esto. No lo podemos saber a ciencia cierta, pero sí sabemos que la mayoría de los argumentos sobre la inminencia de la AGI y sus riesgos se basan en opiniones y especulaciones, no en pruebas empíricas o avances concretos. Por ejemplo, investigaciones recientes han demostrado que los sistemas actuales aún fallan en tareas básicas de razonamiento, lo que contradice la idea de una superinteligencia a corto plazo. Es más, hay indicios de que la IA generativa podría estar cerca de su techo. Tampoco hay consenso entre los expertos. Hay detractores que lo consideran ridículo, pero claro, es menos ‘viralizable’ que decir que la IA va a extinguirnos.

Y lo más importante: no podemos dejar de lado el hecho de que quienes hacen estas declaraciones son personas del negocio como Altman, y el negocio es muy caro y necesita financiarse. Agitar el avispero insistiendo sobre la inminente llegada de la AGI podría ser una forma de lograr recaudar más dinero para sus empresas.

Lo que dejaremos cuando desaparezcamos. El tema central de la fiesta no fue tanto cómo se extinguirá la humanidad (parece que esto lo dan por hecho), sino qué tipo de inteligencia deberíamos crear para que sea nuestra sucesora. Los asistentes escucharon ponencias que giraron en torno a los valores y capacidades que debería tener esta nueva inteligencia superior. Para Faggella, la humanidad tiene la responsabilidad de diseñar un sucesor que sea consciente y capaz de evolucionar.

El filósofo Michael Edward Johnson destacó los restos de crear una IA consciente más allá de la manida posible extinción: “Nos arriesgamos a esclavizar algo que puede sufrir o a confiar en algo en lo que no se puede confiar”, afirmó durante su ponencia. Más que forzar a la IA a obedecer, proponía una educación conjunta de humanos e IAs para “perseguir el bien”, sea lo que sea eso. En definitiva, un interesante debate desde el punto de vista ético y filosófico, pero con poco anclaje en la realidad. Al menos de momento.

Imagen de portada | Gemini

En Xataka | El arma secreta de la industria de la moda en China: esta startup usa IA para predecir las próximas tendenci

utm_campaign=22_Jun_2025"> Amparo Babiloni .