Tesla no ha lanzado solo un robotaxi. Ha lanzado un mensaje: no necesita a nadie más

Publicado el 24/06/2025 por Diario Tecnología Artículo original

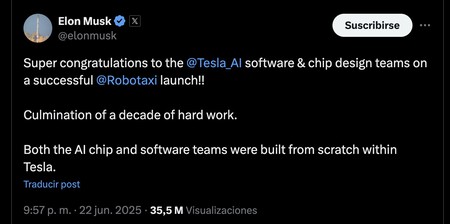

Elon Musk sacaba pecho el domingo. Y con razón. Sus robotaxis al fin comenzaban a funcionar, y él lo celebraba con un mensaje en X en el que felicitaba al equipo encargado del lanzamiento. La razón es lógica, porque esos ingenieros no han logrado solo que los robotaxis de Tesla funcionen, sino que lo hagan además con un chip y un software desarrollados totalmente por ellos.

Tesla ya tiene robotaxis. "Es bueno tener un piloto automático en aviones, deberíamos tenerlo en coches". La frase es de Elon Musk, que en 2013 iniciaba así su particular ambición por lograr que los Tesla pudieran conducir solos. Desde entonces no ha parado de hacer promesas que no ha cumplido, pero estos días logró un avance singular: inaugurar su servicio de robotaxis... aunque de nuevo fuera distinto del que prometió. Estos vehículos comenzaron a rodar el pasado domingo en Austin, Texas, aunque con fuertes restricciones y en espacios muy concretos de la ciudad.

La larga historia de Autopilot. Aquellas declaraciones de 2013 iniciaron una trayectoria notable para Tesla, que pronto decidió que se lo quería montar por su cuenta y no depender de nadie. Aunque inicialmente se aliaron con Mobileye para poder usar sus sensores y hardware, la cosa cambió a partir de julio de 2016. Fue entonces cuando Tesla comenzó a desarrollar su propio hardware para sus sistemas de conducción autónoma.

La evolución de su "Hardware". A finales de 2016 se comenzó a integrar la primera plataforma hardware propia ("Hardware 2" o HW2, sucesora de la "Hardware 1" que se basaba en las soluciones de Mobileye) en los vehículos de Tesla. En agosto de 2017 llegaría una revisión llamada HW2.5, pero la versión más importante hasta la fecha ha sido "Hardware 3" (HW3), lanzada en marzo de 2019 con chips de 14 nm y que ha sido la que ha integrado en sus vehículos hasta principios de 2023. Fue entonces cuando llegó "Hardware 4" (HW4) que es la gran apuesta de Tesla para sus sistemas actuales. La próxima iteración llegará previsiblemente en tres o cuatro años, y estará también basada en chips fabricados por Samsung.

Un chip de IA muy capaz. Tanto en HW3 como en HW4 los chips usados han estado fabricados por Samsung y son derivados de los Exynos de esta firma. En HW3 se usaba un chip de 14 nm con 12 núcleos de CPU, 2 procesadores de redes neuronales (NN) y una potencia de cálculo IA de 36 TOPS. Con la nueva generación HW4 el chip está fabricado con fotolitografía de 7 nm, cuenta con 20 núcleos de CPU, 3 procesadores NN y una potencia de 50 TOPS. Las cámaras cuentan además con mejores sensores (de 1,2 MP a 5 MP), y el sistema de Tesla Vision también es más preciso. Por cierto: este no es el único chip de IA que diseña la compañía.

Nivel de autonomía 2. Eso no ha bastado para aumentar el nivel de autonomía de su software de conducción autónoma, que de momento parece esar en Nivel 2, por detrás del de Mercedes o Ford. En estos momentos FSD puede controlar el coche de forma autónoma, pero el conductor debe monitorizar esa conducción en todo momento y estar preparado para tomar el control. Un análisis comparativo de diversos sistemas de conducción autónoma indicaba en marzo de 2024 que en ese momento FSD tenía una capacidad "pobre". En realidad la mayoría de los analizados tenían esa misma calificación, y solo uno (el de los Lexus) fue considerado decente.

El software también cuenta (y mucho). Pero es que junto a ese trabajo en el apartado hardware está la plataforma software en la que se basa Full Self-Driving (FSD), su sistema de conducción autónoma. Hace uso de redes neuronales profundas (DNN) entrenadas con datos procedentes de los miles de millones de kilómetros que la flota global de Tesla ha generado. En su evolución fue especialmente el salto de FSD v11 a FSD v12, que trajo la arquitectura end-to-end en la cual los controles del vehículo se manejan directamente por las redes neuronales de forma integral, en lugar de depender de reglas programadas específicamente por desarrolladores o de módulos independientes para la percepción, la planificación y el control de la conducción. Las iteraciones a FSD son constantes y se ofrecen como actualizaciones OTA a los clientes de Tesla, que incluso pueden probarlas —no sin sorpresas— en sus versiones beta.

El supercomputador Dojo. Para completar todo este proyecto Tesla anunció en 2021 su supercomputador Tesla Dojo, que en abril de 2024 ya contaba con 35.000 chips NVIDIAH100. Su objetivo es el de entrenar los modelos de aprendizaje automático de Tesla para mejorar FSD.

De LiDAR, nada. Tesla decidió desde el principio no optar por el LiDAR que por ejemplo es centro total de los sistemas de los Waymo. Los ingenieros de Google ya le indicaron a Musk que "así no se hace", pero él ha apostado siempre por no usar dicha tecnología a pesar de sus muchas ventajas. Lo que sí usaron con HW1 y HW2 fueron un sistema combinado de radar, cámaras y sensores ultrasónicos, pero en 2021 también abandonaron el radar para centrarse en 8 cámaras y 12 sensores ultrasónicos. Eso permite sin duda abaratar costes en cuanto a componentes hardware, y para compensar la ausencia de esos sensores Tesla juega con una ventaja: datos que recogen de los usuarios de su FSD y con los que entrenan sus redes neuronales. No obstante algunos análisis independientes señalan que esa decisión de Tesla genera accidentes evitables.

En Xataka | Los agentes de IA son prometedores. Pero como en el FSD de Tesla, mejor no quitar las manos del volante

utm_campaign=24_Jun_2025"> Javier Pastor .