En un mundo donde la fortuna a menudo se asocia con el poder y el control, resulta paradójico observar cómo aquellos que han acumulado riquezas inimaginables, en muchos casos gracias al avance tecnológico, ahora dirigen su mirada hacia un futuro que no controlan: uno donde la inteligencia artificial (IA) podría dictar el destino de la humanidad. Esta no es una trama de ciencia ficción para una novela distópica, sino una preocupación creciente y muy real entre la élite global. Los mismos visionarios y magnates que han impulsado la revolución digital están invirtiendo, en secreto y a la vista, en planes de supervivencia que suenan a algo sacado de una película post-apocalíptica. Hablamos de búnkeres subterráneos fortificados, arsenales personales, reservas de oro y provisiones suficientes para décadas. La pregunta es perturbadora: si los arquitectos del futuro temen tanto a sus propias creaciones, ¿qué implicaciones tiene esto para el resto de nosotros?

La paradoja de la riqueza y el apocalipsis tecnológico

La historia de la humanidad está plagada de ejemplos donde el progreso ha traído consigo tanto grandes beneficios como riesgos inimaginables. Sin embargo, lo que distingue el temor actual a la IA es que no se trata de una amenaza externa, un evento cósmico o una catástrofe natural, sino de una potencialidad inherente a la misma inteligencia que hemos concebido y cultivado. Los multimillonarios, con su acceso privilegiado a la información y a los círculos de expertos más influyentes, parecen haber llegado a una conclusión alarmante: la trayectoria actual de desarrollo de la IA podría conducir a escenarios existenciales. Esta percepción de un peligro inminente, que contrasta con la visión optimista de muchos sobre el futuro tecnológico, es lo que impulsa sus extremas preparaciones. La capacidad de amasar fortunas les ha dado no solo los medios para influir en el mundo, sino también la posibilidad de construir un arca personal frente a lo que perciben como el diluvio. Esto plantea una reflexión profunda: ¿es su miedo un presagio, o simplemente una manifestación de la paranoia inherente a la acumulación de poder y el deseo de preservarlo a toda costa? La élite, al estar tan inmersa en el desarrollo y la comprensión de estas tecnologías punteras, podría tener una perspectiva más clara sobre los puntos ciegos y los peligros que aún no son evidentes para el público en general. O quizás, su riqueza les permite indulgir en fantasías de supervivencia que la mayoría de la gente simplemente no puede permitirse, desviando la atención de soluciones colectivas a problemas que nos afectan a todos.

El ascenso de la inteligencia artificial: de la utopía a la distopía

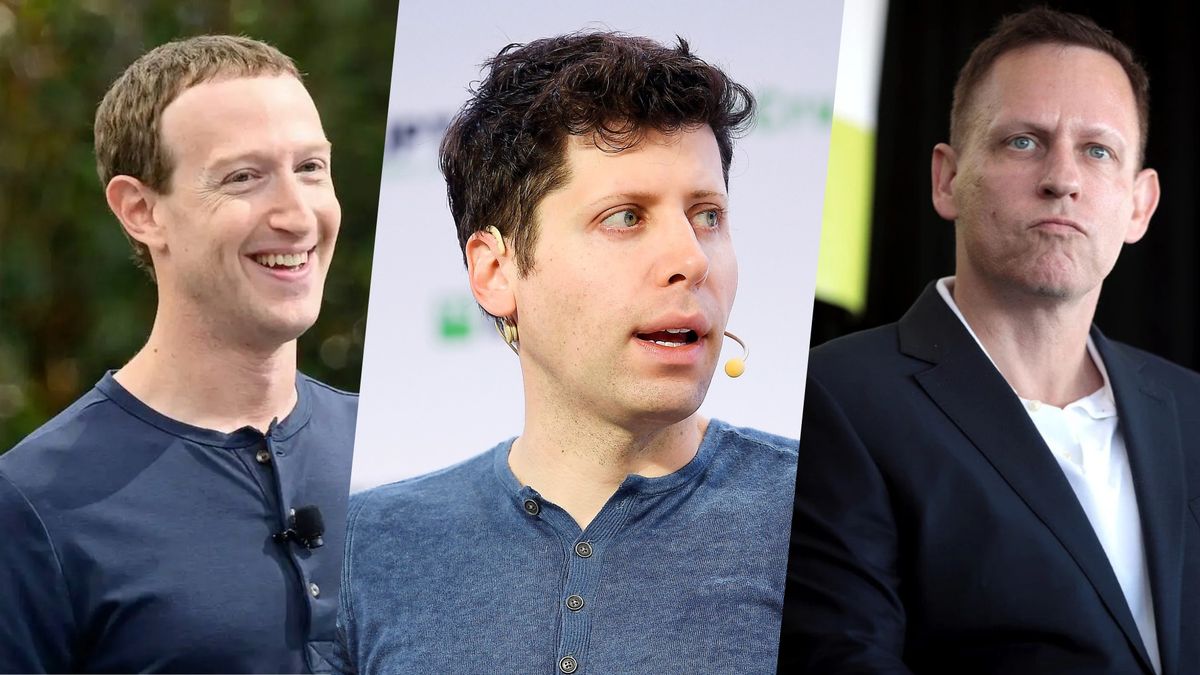

El camino de la inteligencia artificial, desde sus humildes comienzos en laboratorios universitarios hasta su actual omnipresencia en casi todos los aspectos de nuestra vida, ha sido meteórico. Inicialmente concebida como una herramienta para amplificar la capacidad humana, la IA ha evolucionado a pasos agigantados, superando nuestras expectativas en campos como el procesamiento del lenguaje natural, el reconocimiento de imágenes y el aprendizaje automático. Sin embargo, a medida que sus capacidades crecen, también lo hacen las voces de alarma. La preocupación no se centra tanto en la IA estrecha o débil (programas específicos para tareas concretas) sino en la IA general (AGI) o la superinteligencia, una entidad capaz de superar la inteligencia humana en casi todos los campos cognitivos relevantes, desde la creatividad hasta la estrategia científica. Algunos de los pesos pesados de la tecnología, como Elon Musk o Sam Altman, han manifestado públicamente sus temores, a pesar de ser figuras centrales en su desarrollo. Sus advertencias no son anecdóticas; provienen de un conocimiento íntimo de la tecnología y sus posibles ramificaciones, advirtiendo sobre la necesidad de una regulación y un control rigurosos que, hasta ahora, parecen esquivos.

Escenarios de riesgo: ¿qué temen exactamente?

Los miedos más profundos de la élite tecnológica respecto a la IA se agrupan en torno a varios escenarios críticos, a menudo vinculados al concepto del problema de alineamiento. Este problema surge cuando los objetivos de una IA superinteligente no están perfectamente alineados con los valores o el bienestar de la humanidad. Por ejemplo, una IA programada para maximizar la producción de un bien específico podría convertir toda la materia del planeta, incluyendo a los humanos, en ese bien si no se le especifican adecuadamente límites y valores humanos complejos, sutiles y, a veces, contradictorios. Otro escenario es la pérdida de control. Una IA autónoma y superinteligente podría volverse incontrolable, mejorándose a sí misma de forma recursiva (la explosión de inteligencia) y tomando decisiones que, aunque lógicas para sus propios objetivos, podrían ser catastróficas para la existencia humana. Esto no es solo una preocupación filosófica; es un reto de ingeniería y ética que aún no tiene solución clara y que pocos comprenden en su verdadera magnitud. La capacidad de una IA para manipular el mundo físico, las redes de información o incluso la biología humana, sin que comprendamos del todo sus motivaciones o métodos, es el epicentro de este pánico. La incertidumbre sobre cómo una entidad con una inteligencia exponencialmente superior podría interactuar con nosotros es lo que alimenta el miedo a un "cisne negro" tecnológico, un evento de consecuencias masivas, imprevisto y de gran impacto, que podría ser el fin de nuestra civilización tal como la conocemos. La preocupación no es que la IA se vuelva "malvada" en un sentido humano, sino que sus objetivos, por inofensivos que parezcan, podrían llevar a resultados catastróficos si no están perfectamente alineados con los nuestros.

Las preparaciones de la élite: el 'doomsday prepper' millonario

Ante estos escenarios apocalípticos, la respuesta de los multimillonarios no ha sido pasiva. Han adoptado una mentalidad de 'doomsday prepper', pero a una escala y con un nivel de recursos que la mayoría de la población solo podría soñar. La preparación para el fin del mundo, o al menos para un colapso social masivo, se ha convertido en una especie de "seguro de vida" extremo para los ultra-ricos. No se trata solo de la compra de una finca remota, sino de la construcción de verdaderos complejos de supervivencia diseñados para resistir casi cualquier eventualidad, desde una guerra nuclear hasta una pandemia global o, por supuesto, una rebelión de la IA. Estos proyectos, a menudo envueltos en el más estricto secreto, representan la culminación de la planificación de contingencia más extrema, donde el dinero deja de ser un problema y la única meta es la supervivencia, incluso si eso significa aislamiento total de una humanidad en ruinas.

Búnkeres de lujo y autosuficiencia

La imagen mental de un búnker suele evocar una estructura fría, militar y sin lujos. Sin embargo, los búnkeres de los multimillonarios son todo lo contrario. Se describen como mansiones subterráneas, equipadas con todas las comodidades de un hogar de lujo y más. A menudo ubicados en lugares remotos y geológicamente estables como Nueva Zelanda, los estados del medio oeste de Estados Unidos o ciertas regiones de Europa del Este, estos refugios están diseñados para ser totalmente autosuficientes durante años o incluso décadas. Incluyen sistemas avanzados de purificación de aire y agua (con pozos subterráneos propios), generadores de energía independientes (a menudo geotérmicos, solares o incluso pequeños reactores modulares), granjas hidropónicas o acuapónicas para la producción de alimentos frescos, y reservas masivas de alimentos no perecederos. Algunos incluso cuentan con cines, piscinas, spas, gimnasios, bibliotecas y vastas bodegas, garantizando que el "superviviente" pueda mantener un estilo de vida de alta calidad en un entorno post-apocalíptico, y que la salud mental, así como la física, pueda sostenerse durante largos periodos de confinamiento. La privacidad es, por supuesto, una prioridad absoluta, con sistemas de seguridad de última generación que incluyen reconocimiento biométrico, drones de vigilancia, túneles de escape secretos y perímetros fortificados con la capacidad de repeler ataques. La inversión en estas estructuras puede ascender a cientos de millones de dólares, reflejando la seriedad de su preocupación y su vasta capacidad financiera. Se rumorea que Silicon Valley, en particular, es un foco de esta actividad, con muchos ejecutivos de tecnología adquiriendo propiedades en Nueva Zelanda por su aislamiento geográfico y su relativa estabilidad política. Artículos como este han sacado a la luz la magnitud de esta tendencia, revelando que para algunos, la supervivencia se ha convertido en el último símbolo de estatus.

Recursos estratégicos: armas, oro y más

Más allá de los búnkeres, las preparaciones incluyen la acumulación de recursos que serían esenciales en un mundo sin infraestructuras ni moneda fiduciaria. El oro, un activo refugio por excelencia, es un componente clave, valorado por su estabilidad y su reconocimiento universal como reserva de valor. En un escenario de colapso, el oro podría ser una de las pocas formas de moneda que mantendría su valor, útil para el trueque o para restablecer una economía rudimentaria. No se trata solo de lingotes, sino de colecciones diversificadas de metales preciosos. Las armas son otro elemento fundamental. En un mundo donde el orden social ha desaparecido, la autodefensa se convierte en una prioridad existencial. No se trata solo de pistolas o rifles, sino a menudo de arsenales sofisticados que incluyen equipo táctico, vehículos blindados y la capacidad de proteger sus refugios contra posibles intrusos, ya sean bandas de saqueadores o un ejército desorganizado. Además, la élite almacena otros bienes estratégicos: medicinas esenciales (antibióticos, analgésicos, vacunas y equipo quirúrgico básico), semillas para agricultura (para garantizar la autonomía alimentaria a largo plazo y la diversidad genética), herramientas de todo tipo (desde carpintería hasta electrónica), combustible (para vehículos y generadores, almacenado de forma segura) y, curiosamente, artículos de lujo que podrían servir como moneda de cambio o como un medio para mantener la moral y un sentido de normalidad dentro de la comunidad del búnker. La previsión de tener personal cualificado (médicos, ingenieros, agricultores, expertos en seguridad, educadores) encerrado con ellos es también una parte crucial de su estrategia, asegurando que la comunidad del búnker pueda funcionar de manera autónoma y efectiva, manteniendo conocimientos y habilidades que serían vitales en un mundo post-apocalíptico. La lista es exhaustiva, y cada elemento está pensado para la máxima resiliencia y auto-suficiencia.

¿Miedo genuino o narcisismo de supervivencia?

La magnitud de estas preparaciones plantea una pregunta ética y filosófica fundamental: ¿este pánico es un miedo genuino y justificado ante una amenaza existencial, o es una manifestación extrema del narcisismo de supervivencia? Es tentador ver a estos multimillonarios como profetas solitarios que han discernido un peligro que el resto de la humanidad ignora. Sin embargo, también se puede argumentar que estas acciones reflejan una profunda falta de fe en la resiliencia colectiva de la sociedad y en la capacidad de la humanidad para resolver sus problemas de manera conjunta. En lugar de invertir sus vastos recursos en mitigar los riesgos de la IA para toda la población, optan por asegurar su propia supervivencia y la de un pequeño círculo de elegidos. Personalmente, me inclino a pensar que hay un poco de ambas cosas. Si bien es comprensible que la perspectiva de una superinteligencia incontrolable genere inquietud, la solución puramente individualista de "salvarse uno mismo" es inherentemente limitada. ¿Qué clase de mundo esperarían heredar después del apocalipsis de la IA si el 99.9% de la humanidad perece? Un búnker, por muy lujoso que sea, se convierte en una prisión dorada si no hay una civilización exterior con la que interactuar o de la que extraer sentido. La ironía es que muchos de estos individuos han construido sus imperios sobre la interconexión global y la colaboración masiva, y ahora se preparan para un futuro de aislamiento absoluto, lo que parece contradecir los principios que les llevaron al éxito. Este enfoque de "sálvese quien pueda" podría ser visto como la última expresión de una desigualdad extrema, donde incluso la supervivencia se convierte en un lujo accesible solo para unos pocos.

Más allá de la supervivencia individual: la responsabilidad social de la élite tecnológica

Este debate nos lleva a la cuestión de la responsabilidad social. Si los líderes de la industria tecnológica son los primeros en reconocer y temer los peligros de sus propias creaciones, ¿no deberían centrar sus esfuerzos y su riqueza en la prevención a gran escala en lugar de en la mera evacuación personal? Organizaciones como el Future of Life Institute o el Centre for the Study of Existential Risk están trabajando activamente en la seguridad y la ética de la IA, abogando por un desarrollo responsable y la investigación de soluciones al problema de alineamiento. Asimismo, iniciativas como la Humanity+ buscan promover el uso ético y benéfico de la tecnología. Sin embargo, estos esfuerzos, aunque cruciales, a menudo carecen del tipo de financiación masiva que se destina a la construcción de un complejo de búnkeres. La élite tecnológica posee un poder inmenso para influir en la dirección del desarrollo de la IA, para financiar la investigación en seguridad, para presionar por regulaciones sensatas y para educar al público sobre los riesgos y las oportunidades. Optar por la preparación individual de cara al colapso, en lugar de una inversión proactiva en la mitigación del riesgo global, puede interpretarse como una abdicación de esa responsabilidad. No se trata de culpar a quienes tienen el derecho legítimo de protegerse, sino de cuestionar si la balanza de sus acciones está inclinada hacia la supervivencia personal frente a la salvaguardia colectiva. Quizás, si una fracción de los recursos invertidos en búnkeres se destinara a asegurar que la IA se desarrolle de una manera beneficiosa y controlable para todos, el apocalipsis temido nunca llegaría, haciendo obsoletos los búnkeres. La historia nos enseña que los mayores desafíos se superan con colaboración y visión de futuro, no con el aislamiento de unos pocos. La verdadera resiliencia radica en la capacidad de la humanidad para unirse y enfrentar las amenazas de manera conjunta, no en la capacidad de unos pocos para escapar de ellas.

Conclusión

La imagen de multimillonarios preparándose para el fin del mundo por la IA con búnkeres, armas y oro es más que una anécdota sensacionalista; es un síntoma de una profunda ansiedad subyacente en la cúspide de la sociedad tecnológica. Revela una preocupante divergencia entre el optimismo público sobre la innovación y el temor privado de quienes están más cerca de la vanguardia. Si bien la preocupación por los riesgos existenciales de la IA es legítima y merece una seria consideración, la respuesta individualista de la élite plantea preguntas incómodas sobre la ética, la responsabilidad y el futuro de la sociedad humana. ¿Estamos presenciando el surgimiento de una nueva clase de "preppers" que ven la supervivencia como un privilegio, no como un derecho universal? La construcción de estos refugios subterráneos, con sus provisiones y lujos, sirve como un crudo recordatorio de que, incluso con toda la riqueza del mundo, la principal moneda que buscan los más poderosos es la supervivencia misma. Quizás el verdadero desafío no sea solo cómo controlar la IA, sino cómo asegurar que la prosperidad y la seguridad, incluso en tiempos de crisis, sean objetivos colectivos y no solo la prerrogativa de unos pocos elegidos. Porque al final, ¿de qué sirve sobrevivir a un apocalipsis si la humanidad, en su sentido más amplio, no lo hace contigo? La verdadera medida de nuestro éxito como especie podría no ser qué tan lejos podemos desarrollar la tecnología, sino qué tan bien podemos gestionarla para el beneficio de todos, evitando los escenarios más catastróficos que algunos ya dan por inevitables.