El panorama tecnológico ha experimentado una aceleración sin precedentes en la última década, pero lo que hemos presenciado en los últimos dos años, y particularmente en los recientes eventos de Microsoft enfocados en desarrolladores, trasciende la simple evolución. Estamos en el umbral de una era donde la inteligencia artificial no es solo una herramienta, un modelo o una API, sino un compañero omnipresente, un agente autónomo capaz de razonar, planificar y ejecutar tareas complejas. Las presentaciones y demostraciones de Microsoft han disipado cualquier duda: los agentes de IA han llegado para quedarse, infiltrándose en cada capa del desarrollo de software y la interacción humana con la tecnología. Lejos de ser una novedad futurista, estos agentes son ya el presente, redefiniendo no solo cómo creamos software, sino también cómo vivimos y trabajamos. Es un cambio fundamental que exige nuestra atención, comprensión y una adaptación proactina.

La evolución de la inteligencia artificial y su integración en el desarrollo de software

La trayectoria de la inteligencia artificial ha sido un camino fascinante, marcado por picos de entusiasmo y valles de escepticismo. Desde los sistemas expertos de los años 80 hasta el aprendizaje automático y el aprendizaje profundo de la última década, cada etapa ha sentado las bases para la siguiente. Sin embargo, lo que estamos viendo ahora es un salto cualitativo, una transformación que va más allá de la mejora incremental de algoritmos o la capacidad de procesar vastos conjuntos de datos. Estamos siendo testigos del nacimiento y la proliferación de agentes de IA: entidades capaces de una autonomía y una complejidad funcional que antes solo habitaban en el reino de la ciencia ficción. Este cambio de paradigma está reescribiendo las reglas del juego para los desarrolladores y la industria tecnológica en general.

Del modelo al agente: un cambio de paradigma

Durante mucho tiempo, cuando hablábamos de IA, nos referíamos principalmente a modelos. Estos modelos, como los grandes modelos de lenguaje (LLM) o los modelos de visión por computadora, eran herramientas poderosas, sí, pero esencialmente pasivas. Esperaban una entrada, procesaban información y generaban una salida. Su "inteligencia" residía en su capacidad para aprender patrones y hacer predicciones o generar contenido basándose en esos patrones. Eran, en esencia, cerebros sin cuerpo ni voluntad.

El concepto de "agente de IA" introduce una dimensión completamente nueva. Un agente no es solo un modelo; es un sistema que integra uno o varios modelos con capacidades adicionales de razonamiento, planificación, memoria y uso de herramientas. Un agente puede percibir su entorno (digital o físico), procesar esa información, formular un plan de acción para alcanzar un objetivo específico, ejecutar ese plan utilizando diversas herramientas (APIs, bases de datos, otras aplicaciones) y aprender de sus interacciones para mejorar su rendimiento futuro. A mi juicio, este es el paso más significativo en la evolución de la IA desde la introducción de los LLMs. No solo tenemos cerebros más potentes, sino que ahora tenemos la capacidad de darles "manos" y "voluntad" para interactuar con el mundo de forma autónoma. Esto abre un abanico inmenso de posibilidades, pero también trae consigo una serie de desafíos, especialmente en el control y la fiabilidad.

Microsoft como catalizador de esta transformación

Microsoft ha emergido como uno de los principales impulsores de esta transición hacia la era de los agentes. A través de sus eventos para desarrolladores, como Build o Ignite, la empresa ha articulado una visión clara y ha proporcionado las herramientas necesarias para que los desarrolladores puedan construir y desplegar estos agentes. El ecosistema de Azure AI, con sus servicios de IA generativa, sus modelos de lenguaje y sus capacidades de orquestación, se ha convertido en el campo de juego principal.

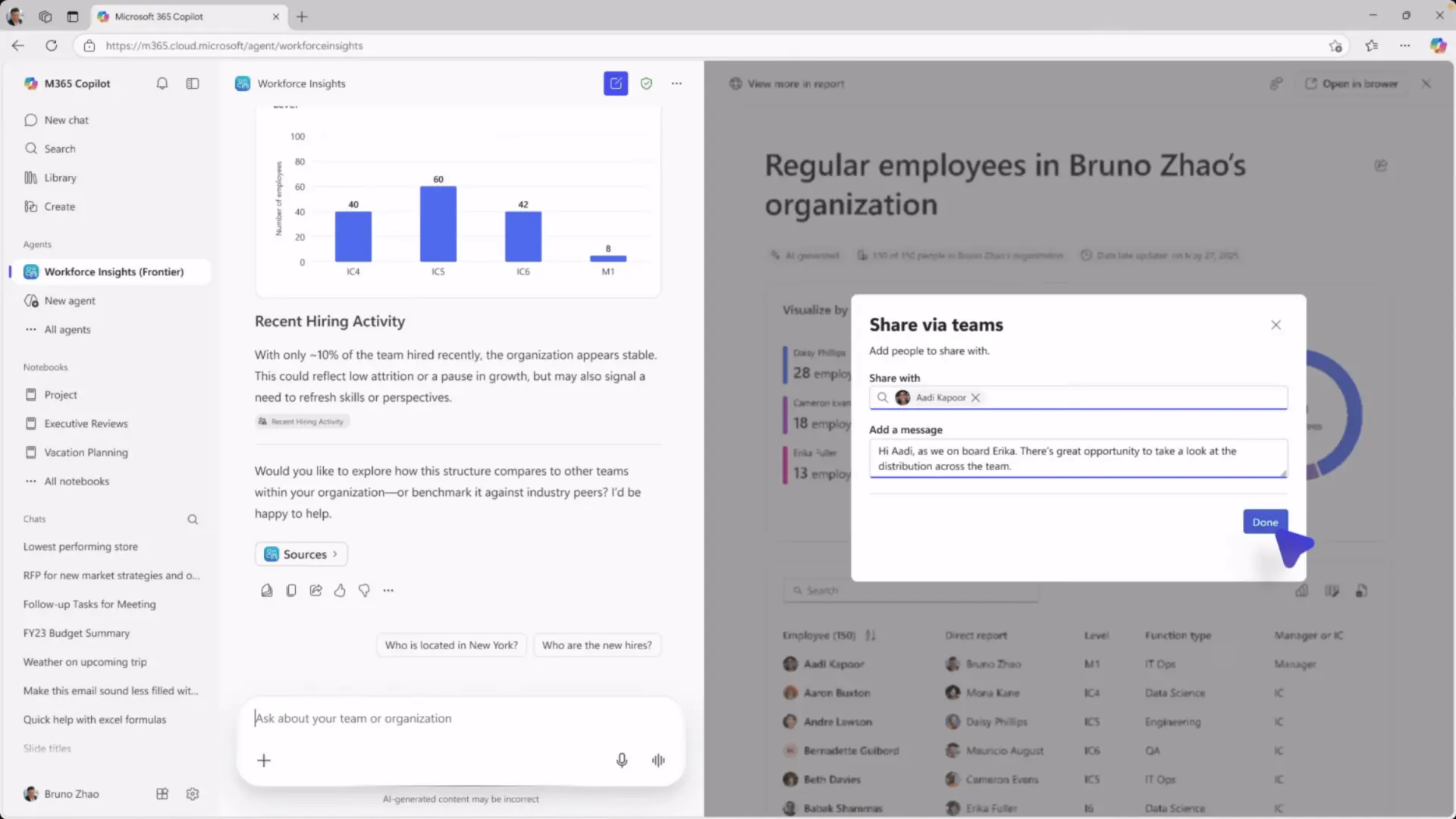

El concepto de 'Copilot Stack' es particularmente revelador. Microsoft no solo ha integrado Copilot en casi todos sus productos (Windows, Office, GitHub), sino que también ha presentado un marco para que los desarrolladores puedan construir sus propios "copilots" o agentes inteligentes. Esto implica proporcionar acceso a modelos de alto rendimiento, herramientas de desarrollo como Semantic Kernel, capacidades de gestión de memoria y contexto, y un conjunto de conectores a diversas aplicaciones y servicios. La estrategia de Microsoft no es solo crear sus propios agentes, sino democratizar la creación de agentes, empoderando a cada desarrollador para que infunda inteligencia autónoma en sus propias aplicaciones. Esto es un movimiento estratégico brillante, ya que asegura que la infraestructura y la visión de Microsoft sean fundamentales para el futuro del desarrollo de agentes. Personalmente, me parece una estrategia muy inteligente para posicionarse como el líder de facto en la infraestructura de la IA.

Para más información sobre las capacidades de Azure AI, visita el sitio oficial de Azure AI.

La arquitectura de los agentes de IA: una visión técnica

Comprender la arquitectura subyacente de los agentes de IA es crucial para los desarrolladores que buscan construir o integrar estas capacidades. No se trata simplemente de llamar a una API de un modelo de lenguaje; es la orquestación de múltiples componentes que trabajan en armonía para lograr una inteligencia más sofisticada y autónoma. La complejidad reside en cómo estos componentes interactúan y se adaptan a las demandas cambiantes de las tareas.

Componentes clave de un agente autónomo

Un agente de IA funcional, especialmente los que Microsoft está promoviendo, suele constar de varios elementos interconectados:

- Modelo de lenguaje (LLM) o Modelo base: Es el "cerebro" del agente, responsable del razonamiento, la comprensión del lenguaje natural y la generación de texto. Es el componente que interpreta las intenciones del usuario, comprende el contexto y formula las respuestas o planes iniciales.

- Planificador: Este componente toma el objetivo general del agente y lo descompone en una serie de pasos discretos y ejecutables. Decide qué herramientas se necesitan, en qué orden y cómo se utilizarán los resultados de un paso como entrada para el siguiente. Es, en esencia, la lógica de negocio del agente.

- Memoria: Crucial para la autonomía a largo plazo, la memoria permite al agente recordar interacciones pasadas, resultados de acciones, preferencias del usuario y conocimiento del dominio. Puede ser una memoria a corto plazo (buffer de contexto) o a largo plazo (bases de datos vectoriales, bases de conocimiento). Sin memoria, cada interacción sería como empezar de cero, limitando severamente la utilidad del agente.

- Uso de herramientas (Tool Use): Aquí es donde el agente cobra vida. Las herramientas son interfaces a servicios externos o funciones internas que el agente puede invocar para interactuar con el mundo. Esto incluye APIs a bases de datos, servicios web, otras aplicaciones, o incluso la capacidad de ejecutar código. La habilidad de un agente para seleccionar y utilizar la herramienta adecuada en el momento oportuno es lo que le permite ir más allá de la mera conversación para realizar acciones concretas.

- Mecanismo de reflexión y auto-corrección: Un agente verdaderamente autónomo debe ser capaz de evaluar los resultados de sus acciones, identificar errores o desviaciones del plan original, y ajustar su comportamiento en consecuencia. Esto es fundamental para la fiabilidad y la adaptabilidad.

Marcos y plataformas para construir agentes

Para facilitar la construcción de estos agentes, han surgido varios marcos y plataformas. Microsoft, por su parte, apuesta fuerte por Semantic Kernel. Semantic Kernel es un SDK de código abierto que permite a los desarrolladores combinar modelos de lenguaje grandes con código tradicional para construir agentes inteligentes. Facilita la orquestación de LLMs, la gestión de memoria, la planificación y el uso de herramientas de una manera estructurada. Su enfoque en los "plugins" es particularmente potente, permitiendo que las aplicaciones existentes expongan sus funcionalidades a los agentes de IA de una manera sencilla y estandarizada.

Otros marcos populares, aunque no exclusivos de Microsoft, como LangChain, también ofrecen capacidades similares para construir agentes. La interoperabilidad entre estos marcos y las plataformas de nube (como Azure AI Studio) es fundamental para permitir a los desarrolladores elegir las herramientas que mejor se adapten a sus necesidades, al tiempo que aprovechan la infraestructura de nube escalable y segura. Lo que me resulta más interesante aquí es la estandarización que se busca para que los agentes no sean "islas" sino parte de un ecosistema interconectado.

Casos de uso y aplicaciones prácticas en el mundo real

La promesa de los agentes de IA no es solo teórica; ya estamos viendo su implementación en una miríada de aplicaciones que transforman la forma en que interactuamos con la tecnología y gestionamos las operaciones. Desde asistentes de codificación hasta la automatización de procesos empresariales complejos, el alcance de los agentes es vasto y sigue expandiéndose.

Asistentes de codificación y depuración (Copilot)

El ejemplo más visible y quizás más impactante para los desarrolladores es la evolución de los asistentes de codificación. GitHub Copilot, impulsado por la tecnología de OpenAI y Microsoft, ha pasado de ser una herramienta de autocompletado avanzado a un verdadero agente. No solo sugiere líneas de código, sino que puede comprender el contexto de un proyecto entero, sugerir la refactorización de código, escribir pruebas unitarias completas, e incluso ayudar en la depuración. Imaginen un agente que no solo detecta un error en su código, sino que también busca soluciones en la documentación, propone una corrección, la aplica, y verifica si resuelve el problema, todo mientras usted se enfoca en la lógica de negocio. Para mí, esta es una de las aplicaciones más transformadoras, ya que acelera drásticamente el ciclo de desarrollo y permite a los ingenieros concentrarse en tareas de mayor valor.

Explora más sobre cómo GitHub Copilot está cambiando el desarrollo en GitHub Copilot.

Automatización de procesos empresariales

En el ámbito empresarial, los agentes de IA están destinados a revolucionar la automatización. Ya no estamos hablando de simples bots de RPA (Robotic Process Automation) que siguen reglas rígidas. Los agentes pueden manejar tareas más flexibles y adaptables:

- Gestión de clientes: Un agente puede responder a consultas complejas de clientes, procesar pedidos, gestionar devoluciones e incluso anticipar necesidades basándose en el historial. Puede acceder a sistemas CRM, ERP y bases de conocimiento para proporcionar respuestas personalizadas y ejecutar acciones.

- Análisis de datos y generación de informes: Agentes que recopilan datos de múltiples fuentes, realizan análisis complejos, identifican tendencias y anomalías, y generan informes detallados en lenguaje natural, todo con una mínima intervención humana.

- Orquestación de flujos de trabajo: Un agente puede coordinar múltiples sistemas y equipos para llevar a cabo procesos empresariales complejos, como la incorporación de nuevos empleados, la gestión de proyectos o la aprobación de gastos, asegurando que cada paso se complete a tiempo y según las políticas establecidas.

Experiencias de usuario personalizadas

Los agentes también están transformando las experiencias de usuario, haciéndolas más intuitivas y personalizadas.

- Contenido dinámico: Un agente puede adaptar el contenido de un sitio web o una aplicación en tiempo real, mostrando información relevante basada en el comportamiento del usuario, sus preferencias y su contexto actual.

- Interfaces adaptativas: Las interfaces de usuario pueden evolucionar y adaptarse a las necesidades de cada usuario, simplificando la navegación o presentando las funcionalidades más utilizadas de forma prominente.

- Recomendaciones proactivas: Más allá de las recomendaciones pasivas, los agentes pueden actuar proactivamente, sugiriendo acciones, productos o servicios antes de que el usuario los busque, basándose en la comprensión profunda de sus patrones y necesidades.

Seguridad y operaciones de TI

Finalmente, la seguridad cibernética y las operaciones de TI son áreas donde los agentes de IA pueden tener un impacto masivo.

- Detección de amenazas: Agentes de seguridad que monitorean constantemente las redes y los sistemas en busca de patrones sospechosos, identifican ataques en curso y alertan a los equipos humanos.

- Respuesta a incidentes: Ante una amenaza, un agente podría iniciar automáticamente contramedidas, aislar sistemas comprometidos y recopilar forenses para el análisis posterior, reduciendo el tiempo de respuesta.

- Monitoreo y optimización de sistemas: Agentes que monitorean el rendimiento de la infraestructura de TI, predicen fallos, optimizan la asignación de recursos y realizan mantenimiento proactivo.

Los desafíos y consideraciones éticas en la era de los agentes de IA

Si bien el potencial de los agentes de IA es inmenso y transformador, no podemos ignorar los desafíos inherentes y las profundas consideraciones éticas que su proliferación trae consigo. La autonomía de estos sistemas, su capacidad para tomar decisiones y ejecutar acciones, nos obliga a reflexionar sobre la responsabilidad, la transparencia y el impacto en la sociedad. Ignorar estos aspectos sería una negligencia con consecuencias potencialmente graves.

Fiabilidad y control: la cuestión de la autonomía

Uno de los mayores desafíos es garantizar la fiabilidad y mantener un control adecuado sobre los agentes autónomos. ¿Qué sucede cuando un agente "alucina" o interpreta mal una instrucción y toma una acción no deseada? Los modelos de IA aún no son perfectos y pueden cometer errores, a veces con consecuencias significativas. La preocupación no es solo la inexactitud, sino la "caja negra" inherente a muchos sistemas de IA, que dificulta comprender por qué un agente tomó una decisión particular. Esto plantea preguntas cruciales sobre la responsabilidad: ¿Quién es responsable cuando un agente de IA falla? ¿El desarrollador, la empresa que lo implementa, o el propio agente? Establecer mecanismos robustos de supervisión humana, de interrupción de emergencia y de trazabilidad de las decisiones es fundamental para construir confianza y seguridad. Creo firmemente que la intervención humana debe ser un pilar fundamental en cualquier diseño de agente crítico.

Sesgos y equidad

Los agentes de IA son tan buenos como los datos con los que son entrenados. Si estos datos contienen sesgos inherentes (sociales, culturales, históricos), el agente no solo los replicará, sino que podría amplificarlos. Un agente de contratación, por ejemplo, podría discriminar sin querer a ciertos grupos demográficos si fue entrenado con datos de contrataciones pasadas que reflejaban sesgos humanos. Abordar el sesgo requiere un esfuerzo concertado para curar conjuntos de datos más justos y representativos, implementar técnicas de mitigación de sesgos en los algoritmos, y realizar auditorías continuas para detectar y corregir desigualdades. La equidad no es un extra; debe ser un principio de diseño central.

Seguridad y privacidad de los datos

Los agentes de IA, por su naturaleza, a menudo acceden y procesan grandes cantidades de datos, muchos de los cuales pueden ser sensibles o personales. Esto plantea serias preocupaciones sobre la seguridad y la privacidad. ¿Cómo se protegen estos datos del acceso no autorizado? ¿Cómo se asegura que el agente cumpla con las regulaciones de privacidad como el GDPR o la CCPA? Un agente comprometido podría convertirse en una puerta de entrada para la filtración de datos o ataques maliciosos. Los desarrolladores deben implementar prácticas de seguridad robustas, cifrado de datos, control de acceso estricto y anonimización siempre que sea posible. La confianza del usuario depende directamente de la capacidad de garantizar la privacidad y seguridad de su información.

Para aprender más sobre la IA responsable, visita el portal de IA responsable de Microsoft.

La redefinición de los roles humanos

La omnipresencia de los agentes de IA también plantea preguntas importantes sobre el futuro del trabajo y la redefinición de los roles humanos. Si los agentes pueden automatizar tareas cognitivas complejas, ¿qué significa esto para los profesionales en campos como la programación, el servicio al cliente o el análisis de datos? Si bien es poco probable que la IA elimine empleos a gran escala en el corto plazo, ciertamente cambiará la naturaleza de muchos de ellos. Los humanos probablemente se centrarán en tareas que requieran creatividad, pensamiento crítico, empatía e interacción social, mientras que los agentes se encargarán de tareas repetitivas o de gran volumen. Esto requiere una inversión significativa en la recapacitación y mejora de habilidades de la fuerza laboral, preparando a las personas para colaborar con agentes de IA en lugar de competir contra ellos.

El futuro de la interacción humano-máquina a través de agentes

Mirando hacia el horizonte, la era de los agentes de IA promete transformar radicalmente la forma en que interactuamos con la tecnología. Ya no estaremos limitados por interfaces rígidas o comandos explícitos. En su lugar, nos moveremos hacia una interacción más fluida, natural y proactiva, donde la tecnología anticipa nuestras necesidades y actúa en consecuencia.

Una interfaz conversacional y proactiva

El lenguaje natural se establecerá como la interfaz predominante para interactuar con los sistemas. En lugar de navegar por menús o aprender sintaxis de comandos, simplemente hablaremos o escribiremos a nuestros agentes, expresando nuestras intenciones de la misma manera que lo haríamos con otro ser humano. Pero más allá de la conversación, la clave será la proactividad. Los agentes no esperarán a que les demos una instrucción; observarán nuestro comportamiento, aprenderán nuestras preferencias y, basándose en el contexto, ofrecerán ayuda o ejecutarán tareas antes de que se lo pidamos. Imaginen un agente que, al detectar que su calendario está lleno y que se acerca una fecha límite importante, sugiere automáticamente reorganizar su agenda o delegar un